多数人对于结论的关心,远胜过形成结论的过程

我们往往急于得到一个笃定的答案、一个现成的判断,却鲜少愿意深究结论依托的论据、推导的逻辑与潜藏的前提。这种重结果、轻过程的认知“本能”,本就容易让人疏于思考,而 AI 的普及更是放大了这一问题,让 “拿来主义” 的认知陷阱变得愈发隐蔽且危险。

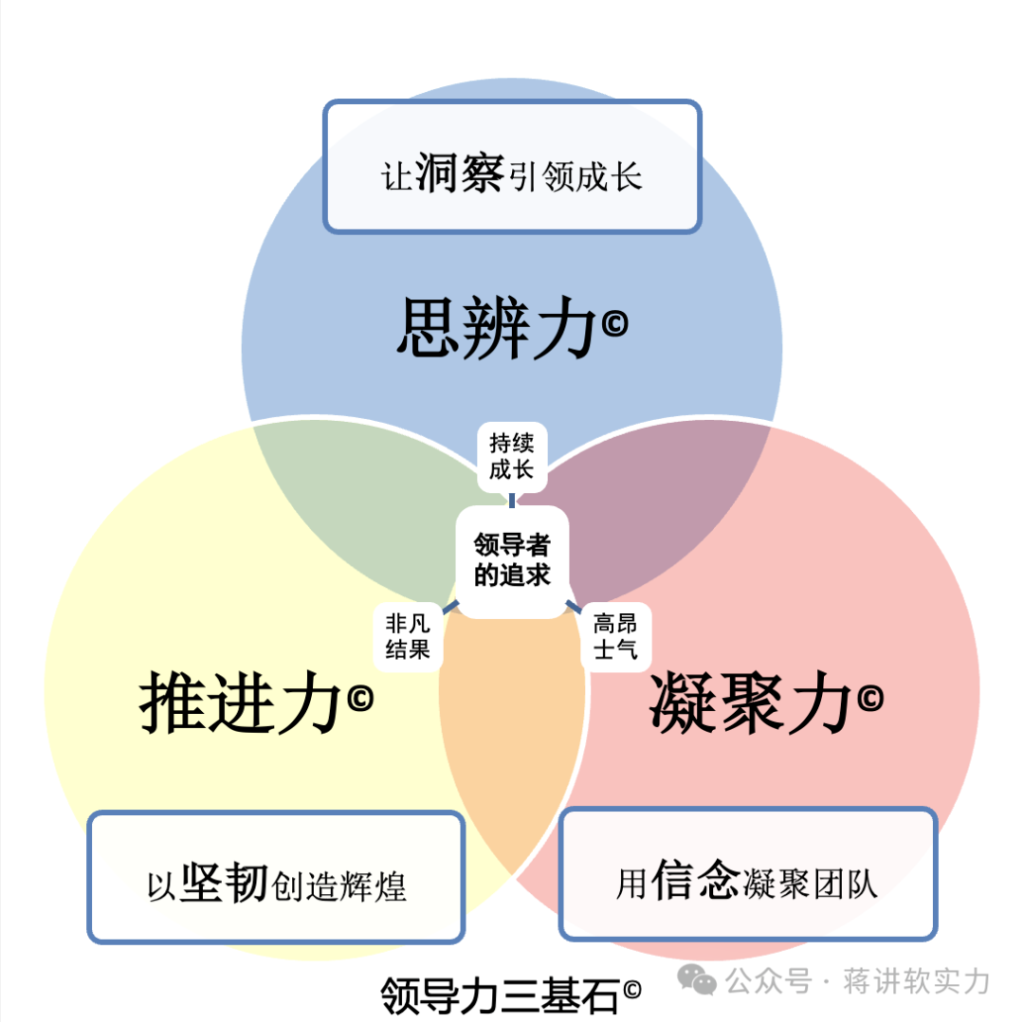

当我们用搜索引擎查询“术后低烧是否正常”,屏幕上会跳出十几条信息:“术后吸收热的特点”“感染性发热的症状”“医生建议的处理方式”……我们必须逐条比对、筛选,甚至交叉验证,才能拼凑出自己的判断。这个过程虽然繁琐,却像一场“强制思考训练”,逼着我们调动逻辑分析能力——这正是思辨力(Critical Thinking,很多人称之为“批判性思维”)的核心所在。但现在,AI会直接给出一句“术后3天低烧多为正常吸收热,无需过度担心”,简洁的结论像一块“认知捷径”,让我们下意识忽略背后的推理过程——这正是危险的开始:AI提供的结论,可能披着“逻辑闭环”的外衣,却藏着论据不可靠或论证假设错误的隐患,而我们正逐渐失去运用思辨力对这种“完美结论”进行审视和分辨的能力。

搜索引擎是信息仓库,AI是结论打包员

搜索引擎像一个“信息仓库”,它把所有可能相关的材料摊开在你面前,对错好坏全靠自己判断。比如想了解“某股票是否值得买”,搜索引擎会列出公司财报、行业研报、网友评论,甚至还有相反观点的分析文章。你必须主动甄别哪些数据是最新的,哪些报告来自权威机构,哪些观点带有主观偏见,这个过程中,你的思辨力一直在运转。

但AI更像一个“结论打包员”,它直接把“建议买入”或“建议卖出”的答案递给你,还附上一套看似严密的推理:“因为市盈率低于行业均值,营收连续三年增长,所以值得投资”。这种“信息-推理-结论”的完整呈现,很容易让人误以为它的论据100%可靠、论证无懈可击,却忘了问一句:它引用的市盈率数据是最新的吗?营收增长是否包含非经常性损益?更关键的是,“市盈率低、营收增长就等于值得投资”这个隐藏的假设,是否适用于当前市场环境?

隐藏假设错误,是AI结论最易被忽视的漏洞

AI结论的迷惑性,不仅来自论据的可能失真,更来自论证中隐藏假设的难以察觉。就像当年阿尔茨海默症的治疗研究,基于一篇被认为“论据真实”的论文,推导出一系列治疗方案,后来却发现论文的核心假设存在错误——论据或许没问题,但从论据到结论的“桥梁”塌了,整个结论自然站不住脚。

对很多人来说,验证论据的真实性已经需要花费精力,而识别那些藏在逻辑链条深处的假设错误,更是对他们思辨力的巨大考验。AI不会主动暴露这些假设,它只会给你一个“看起来对”的结论。如果一个人习惯以“拿来主义”对待AI提供的结论,就会失去“追问假设”的意识,让思辨力不断退化,直到消失。

“结论优先”,正削弱我们的思辨力

更值得警惕的是,AI的“结论优先”会削弱我们的“深度思考”能力。很多时候,我们用搜索引擎查信息,本来只是想找个参考,结果在比对信息的过程中,反而形成了更全面的认知;但用AI时,我们往往带着“找答案”的明确目的,一旦得到结论,就容易停止思考,把AI的结论当成“标准答案”。

就像把AI当成“下属”,它递上来的“建议报告”在形式上逻辑清晰、结论明确,我们很可能因为“懒得核对数据来源、挑战隐藏假设”,就直接采纳,却忘了这个“下属”可能会因为“信息不全”“数据错误”或“假设偏差”,给出看似正确却暗藏风险的建议。

坚持思辨,为自己的判断负责

所以,面对AI提供的结论,我们最该做的,是保留像使用搜索引擎时那样的“审视习惯”——不急于接受结论,而是运用思辨力去追问一句:“这个结论的论据来自哪里?论证中隐藏了什么假设?是否有其他可能性?”毕竟,AI能给我们“结论”,但“为结论负责”的,永远是我们自己。

往期推荐:

献给没空读书的你

如何高质量用好AI:一家世界顶级跨国公司的AI应用实践

年底汇报变“AI狂欢”:当员工放弃思考,识别“真伪”成了管理者的最大负担